Современные системы искусственного интеллекта, используемые для распознавания изображений, невероятно мощны и обладают огромным потенциалом для коммерческого применения. Тем не менее современные искусственные нейронные сети — алгоритмы глубокого обучения, обеспечивающие распознавание изображений, — имеют один огромный недостаток: их легко взломать даже слегка измененными изображениями.

Это отсутствие «надежности» является серьезным препятствием для исследователей, надеющихся создать более совершенные ИИ. Однако точно, почему это явление происходит, и лежащие в его основе механизмы остаются в значительной степени неизвестными.

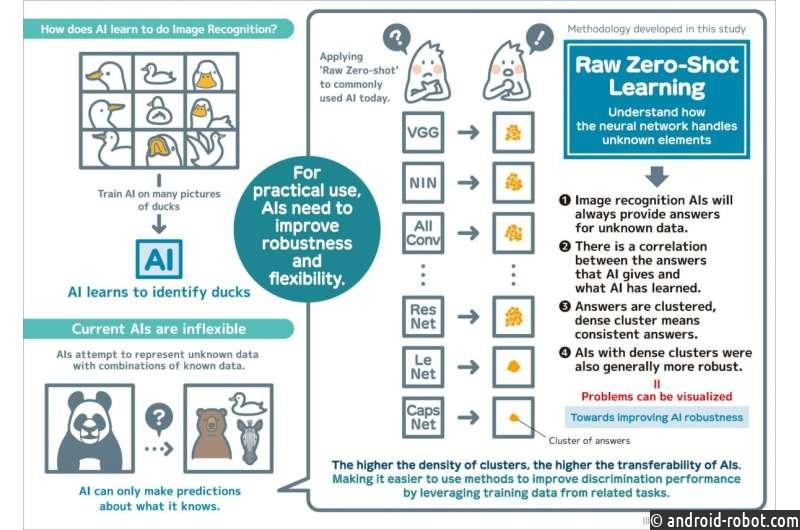

Стремясь когда-нибудь преодолеть эти недостатки, исследователи факультета информатики и электротехники Университета Кюсю опубликовали в PLOS ONE метод под названием «Raw Zero-Shot», который оценивает, как нейронные сети обрабатывают неизвестные им элементы. Результаты могут помочь исследователям определить общие черты, которые делают ИИ «ненадежными», и разработать методы решения их проблем.

«Существует ряд реальных приложений для нейронных сетей распознавания изображений, включая беспилотные автомобили и диагностические инструменты в здравоохранении», — объясняет руководитель исследования Данило Васконселлос Варгас. «Однако, как бы хорошо ни был обучен ИИ, он может дать сбой даже при незначительном изменении изображения».

На практике ИИ распознавания изображений «обучаются» на множестве образцов изображений, прежде чем их попросят идентифицировать одно из них. Например, если вы хотите, чтобы ИИ идентифицировал уток, вы должны сначала обучить его на множестве изображений уток.

Тем не менее, даже самые хорошо обученные ИИ могут быть введены в заблуждение. На самом деле, исследователи обнаружили, что изображением можно манипулировать так, что, хотя оно может показаться человеческому глазу неизменным, ИИ не сможет его точно идентифицировать. Изменение изображения даже на один пиксель может вызвать путаницу.

Чтобы лучше понять, почему это происходит, команда начала исследовать различные ИИ распознавания изображений в надежде выявить закономерности их поведения при столкновении с образцами, с которыми они не были обучены, то есть с элементами, неизвестными ИИ.

«Если вы дадите изображение ИИ, он попытается сказать вам, что это такое, независимо от того, правильный ответ или нет. Итак, мы взяли двенадцать наиболее распространенных сегодня ИИ и применили новый метод под названием «Необработанный нуль». Shot Learning», — продолжает Варгас. «По сути, мы дали ИИ серию изображений без подсказок или обучения. Наша гипотеза заключалась в том, что в их ответах будут корреляции. Они будут неправильными, но неправильными в той же степени».

То, что они нашли, было именно этим. Во всех случаях ИИ, распознающий изображения , выдаст ответ, и ответы — пусть и неверные — будут последовательными, то есть они будут сгруппированы вместе. Плотность каждого кластера будет указывать на то, как ИИ обрабатывал неизвестные изображения, основываясь на своих фундаментальных знаниях о различных изображениях.

«Если мы поймем, что делал ИИ и что он узнал при обработке неизвестных изображений, мы можем использовать это же понимание, чтобы проанализировать, почему ИИ ломается, сталкиваясь с изображениями с однопиксельными изменениями или небольшими модификациями», — заявляет Варгас. «Использование знаний, которые мы получили, пытаясь решить одну проблему, применяя их к другой, но связанной проблеме, известно как переносимость».

Команда заметила, что Capsule Networks, также известная как CapsNet, создает самые плотные кластеры, обеспечивая лучшую переносимость среди нейронных сетей . Они считают, что это может быть связано с динамической природой CapsNet.

«Хотя сегодняшние ИИ точны, им не хватает надежности для дальнейшего использования. Нам нужно понять, в чем проблема и почему она возникает. В этой работе мы показали возможную стратегию изучения этих проблем», — говорит Варгас.

«Вместо того, чтобы сосредотачиваться исключительно на точности, мы должны исследовать способы повышения надежности и гибкости. Тогда мы сможем разработать настоящий искусственный интеллект».