Нейронные сети кажется уже навсегда вошли в нашу жизнь, являясь одновременно и нашими помощниками, и угрозами, и некоторой магией – а как же это все-таки работает?

Наши смартфоны оснащаются различными системами биометрии, в основе которых лежат нейронные сети – распознавание лиц, отпечатки пальцев, распознавание радужки глаз и другие.

Мы расскажем об уязвимостях нейросетевых технологий.

Известный писатель-фантаст Артур Кларк как-то сказал:

«Если знаменитый, но старый ученый утверждает, что нечто возможно, он почти определенно прав. Если он утверждает, что нечто невозможно, он, очень вероятно, ошибается»

Если перевести эту цитату на наш бизнес язык, то должно звучать примерно так:

«Если известные эксперты или крупные компании заявляют, что нечто невозможно– они, очень вероятно, ошибаются».

Собственно эту мысль мы будем эксплуатировать далее на практических примерах. Но сначала давайте попробуем разобраться – как работает фотобиометрия.

Пару лет назад в небольшой американском городе Ланкастер произошла необычная бытовая история. В полицию обратились пострадавшие покупатели, которых на местном рынке обманывал мошенник. Пока продавцы отлучались от своих прилавков, мошенник представлялся хозяином прилавка, брал деньги с покупателей и исчезал. Один из свидетелей нарисовал очень схематичный портрет мошенника, но уже на следующий день полиция поймала преступника.

В заявлении ведомства говорилось: «Хоть портрет, предоставленный свидетелем, мог показаться неумелым и карикатурным, он, вместе с описанием физических особенностей

подозреваемого, помог сотруднику полиции вспомнить его имя». Преступником оказался бездомный по имени Хунг Фыок Нгуен.

Да, возможно портрет преступника получился очень схематичным и не все черты лица похожи, но какое-то сходство с оригинальной фотографией все-таки есть.

Примерно так работает наш мозг, когда распознает лица-нам не нужна глубокая детализация, достаточно каких-то неуловимых грубых паттернов. И примерно также работают фотобиометрические системы, в основе которых лежат сверточные нейронные сети.

Принципы работы сверточных нейронных сетей достаточно простые – есть слои сверток и есть слои пулинга, с помощью которых выделяются контрастные участки на фотографиях. За счет такой архитектуры нейросеть обрабатывает контуры на изображении лица, не вдаваясь в глубокую детализацию.

В результате обработки изображения нейросеть формирует несколько карт признаков. Первая карта содержит набор простых черточек. Вторая – более сложных линий. Следующая карта, более высокого уровня, выделяет целые формы – глаз, ухо, нос и прочее. И так далее до полных лиц.

Такая архитектура нейронной сети позволяет добиться очень высокой точности распознавания лиц за счет двух основных свойств:

- Первое свойство – это иерархичность. Операция «свертки» позволяет создавать иерархичные карты признаков: от черточек к сложным объектам;

- Второе свойство – это отсеивание шумов с помощью операции «пулинг».

Итак, подытоживая, мы теперь знаем, что сверточная нейронная сеть обрабатывает контуры на изображении лица, не вдаваясь в глубокую детализацию.

Григорий Бакунов из компании Яндекс, хорошо понимающий эти принципы, придумал алгоритм, генерирующий случайный макияж, который ломает системы распознавания лиц. Принципы работы алгоритма те же, что у сверточных нейронных сетей – на лицо добавляется несколько ярких полосок или точек, которые нейросеть считает за контуры лица. В результате нейронка не может сравнить разрисованное лицо с базовой фотографией.

Таким способом Григорий Бакунов продемонстрировал, что системы распознавания лиц уязвимы и легко обходятся. Но с таким макияжем вы вряд ли придете в банк, и вам вряд ли одобрят кредит. Более того, такой макияж уже стал объектом внимания полицейских и скоро возможно станет вне закона.

Способы обмана систем распознавания лиц были придуманы еще до Григория Бакунова. Например, в 2014 году в продаже появилась бейсболка Justice Cap, оснащенная светодиодами, которые засвечивали лицо для фото и видео камер. Это очень простой и эффективный способ скрыться от видеонаблюдения. И стоила такая кепка всего 15$ долларов.

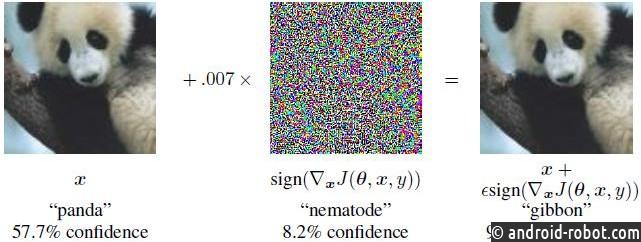

В 2015 году американский математик Ян Гудфелоу разработал алгоритм для атаки на нейронные сети, распознающие объекты на фотографиях. Он добавил к фотографии панды специально сгенерированный шум и получил изображение, которое нейронная сеть распознавала как гиббона, хотя человеку по-прежнему видел панду на обработанной фотографии.

Этот пример стал хрестоматийным для научных исследований и показал темную сторону генеративно-состязательных нейронных сетей (которые, кстати, тоже придумал Гудфелоу).

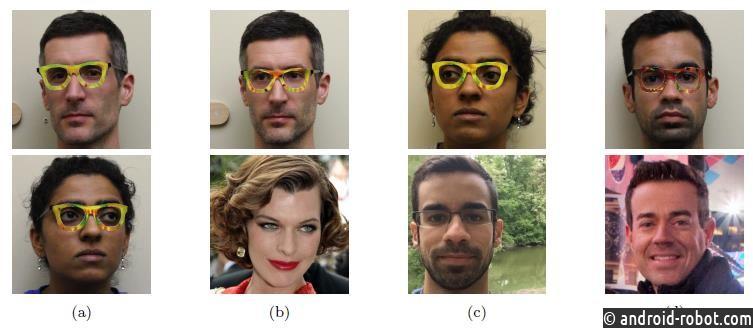

Годом позже исследователи из Университета Карнеги-Меллона (США) продолжили развивать идеи Гудфелоу и предложили с помощью нейросетей генерировать специальный принт для оправы очков. Цель была та же – обойти системы распознавания лиц. Разработанная нейронная сеть позволила подбирать специальные принты, которые делают из человека любую выбранную знаменитость (или другого человека). Например, один из исследователей, надев такие очки, стал для фотобиометрической системы Милой Йовович.

Еще спустя год на одной из выставок дизайнер Дзинь-Цай Лю предложила надевать на голову портативный проектор, который проецирует на лицо человека другое лицо. И хотя это был арт-проект без практической реализации, эту идею позже подхватили китайские исследователи.

В 2018 году инженеры из Фуданьского университета и компании Алибаба предложили использовать инфракрасные светодиоды для взлома систем распознавания лиц. Для этого они прикрепили светодиоды на нижнюю часть козырька обычной кепки. Принцип работы достаточно простой: инфракрасные лучи, падающие на лицо человека, образуют пятна, которые не видны человеческому глазу, но фотокамера их отлично ловит. В результате на систему распознавания лиц отправляется фотография с пятнами, которую нейросеть не может сравнить с базовой фотографией.

Кроме простого взлома, инженеры разработали сложный режим работы светодиодов. Они обучили модель, которая обманывает Open Source фотобиометрию FaceNet от компании Google. Разработанная учеными модель оптимизирует несколько параметров: яркость луча, угол наклона луча и диаметр пятна. В результате можно загрузить фотографию жертвы и алгоритм выдаст оптимальные параметры калибровки светодиодов, чтобы фотобиометрия FaceNet распознала на фото жертву, а не мошенника. Для людей с похожим типом внешности (раса, пол и т.д.) точность прохождения фотобиометрии за жертву составила около 70%.

Такую кепку можно сделать и собственными руками, закупив комплектующие в обычном магазине электроники. Единственным неудобством такой кепки является то, что инфракрасный свет оставляет ожоги на коже человека. Поэтому исследователи не рекомендовали носить кепку с работающими светодиодами более одной минуты.

Несмотря на то, что атаки на нейронные сети могут использовать и преступники, ученые пытаются найти в этих разработках добрую миссию – например, использовать атаки на нейронные сети как борьбу с «Большим братом». Так, недавно чикагские инженеры бросили вызов технологическим компаниям, собирающим фотографии о пользователях в интернете с целью последующей перепродажи этих данных полицейским ведомствам и частным компаниям.

Ученые разработали инструмент под названием Fawkes (Фокс), который маскирует фотографии для защиты от фотобиометрических систем. Исследователи смогли обмануть системы распознавания лиц от Amazon, Microsoft и китайской технологической компании Megvii. Всего за месяц Fawkes скачали больше 50 тысяч раз с сайта для разработчиков. Сейчас инженеры работают над бесплатной версией для массового пользователя.

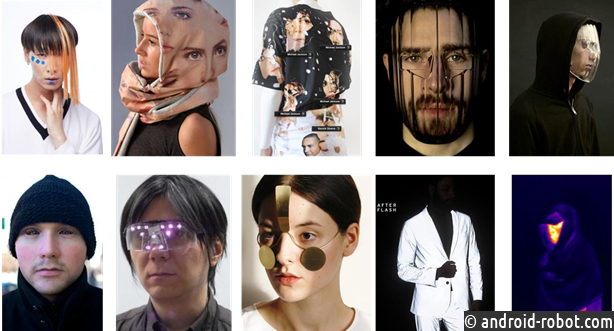

За несколько лет существования фотобиометрических систем было придумано множество способов их взлома: специальный макияж, платки и накидки с лицами других людей, стеклянные преломляющие маски, накладные маски с чужим лицом, очки со светодиодами и даже светоотражающая одежда (например, костюм с вкраплением светоотражающих нитей, из-за которых на фото виден только сам костюм).

Итак, обмануть системы распознавания лиц оказалось не очень сложно, если использовать специальный макияж, очки или кепку со светодиодами. Но макияж и очки – это все детские шалости по сравнению с тем, что умеют делать генеративно-состязательные сети.

Генеративно-состязательные сети (GAN) были предложены американским математиком Яном Гудфеллоу в 2014 году (который потом с помощью таких сетей сделал из панды гиббона). Принцип работы ГАНа достаточно простой: сеть состоит сразу из двух нейронных сетей – генератора и дискриминатора. Задача генератора создавать искусственные данные (фотографии, голоса, мелодии и т.п.), а задача дискриминатора попытаться отличить сгенерированные данные от настоящих. Таким образом при обучении ГАНа происходит некоторая антагонистическая игра – генератор пытается обмануть дискриминатор, а дискриминатор пытается выявить этот обман. За счет такой соревновательной концепции с помощью ГАНов получается генерировать данные очень высокого качества.

ГАНы быстро стали популярными и нашли свое применение в таких приложениях как PRISMA, MSQRD, виртуальный макияж ModiFace, виртуальная примерочная Wannaby и другие.

Но также быстро проявилась и темная сторона ГАНов. В конце 2017 года на ресурсе Raddit пользователь под ником Deepfakes выложил несколько видео низкого социального содержания, в которых лица действующих героинь были заменены на голливудских звезд.

Всего через пару месяцев, в январе 2018 года, в интернете появилось приложение FakeApp, с помощью которого можно было подставлять лицо любого человека в любое видео. Причем для работы в приложении не нужно было обладать навыками программирования или специальными знаниями о нейронных сетях – любой пользователь мог создать свой дипфейк (почему-то больше всех в этих экспериментах досталось Николасу Кейджу).

Однако в первой версии FakeApp для создания качественного дипфэйка требовалось загружать несколько фотографий лица человека, снятого с разных ракурсов, а рендеринг видео мог отрабатывать всю ночь. При этом в любительских дипфэйках было много графических артефактов.

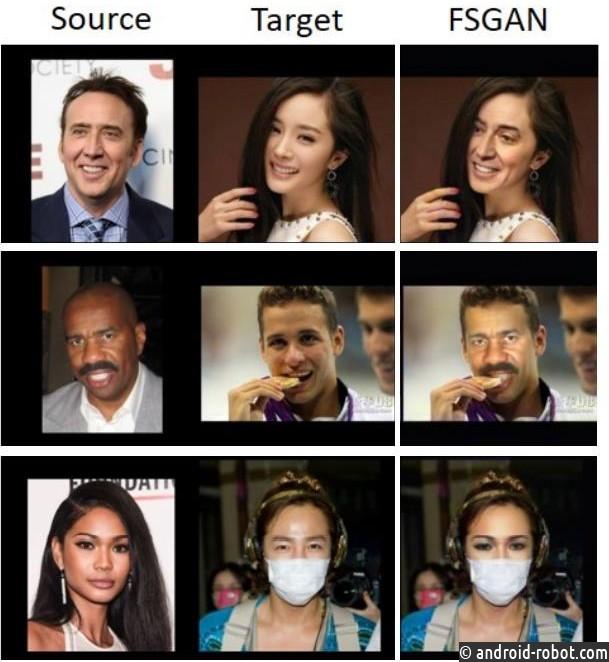

В 2019 году израильские ученые решили проблему низкой скорости разработки дипфэйков, предложив нейронную сеть FSGAN, которая позволяет в режиме реального времени заменять лица на видео, не требуя для этого длительной обработки. Авторы разработки утверждают, что в отличие от предыдущих подходов deepfakes их метод работает для любых двух лиц без какой-либо специальной обработки изображений (проверено на Николасе Кейдже!).

Сразу после появления дипфэйков началась борьба снаряда и брони. В 2018 году немецкие и итальянские ученые разработали нейросеть XceptionNet, которая умеет выявлять подмену лиц на фото или видео. По точности распознавания XceptionNet превосходила существующие на тот момент алгоритмы в несколько раз даже при оценке на сжатых видео. Интересно, что это исследование спонсировалось агентством DARPA департамента обороны США.

Антидипфэйк нейронки применяются и для защиты фотобиометрических систем как одна из разновидностей Liveness Detection – технологии, которая позволяет убедиться, что перед фотокамерой находится живой человек, а не заранее сделанная фотография или видеозапись.

Есть несколько видов Liveness Detection для фотобиометрических систем:

- Интерактивное подтверждение – когда человека просят подмигнуть на камеру, или улыбнуться, или покачать головой. Причем, чтобы это действие не было предварительно записано на видео, система просит выполнить его из случайно выбранных. Такая защита легко обходится, например, с помощью кепки с инфракрасными светодиодами, о которой я рассказывал в предыдущем посте: перед камерой будет стоять живой человек с инфракрасными пятнами на лице. Также интерактивное подтверждение можно обойти с помощью дипфэйков, которые позволяют «приклеивать» лицо другого человека в реальном времени (аналог анимоджи для смартфонов).

- Анализ текстур – позволяет выявлять дипфэйки и распознавать, что фотография сделана с плоского изображения. Обходится с помощью все той же кепки со светодиодами.

- 3D-камера – тоже считается технологией Liveness Detection, хотя по сути является 3D-фотобиометрией, которой оснащены, например, iPhone X. Такую защиту сложнее обойти, чем интерактив или текстуры, но, к сожалению, 3D-камеры тоже уязвимы.

Интерактив

Текстуры

3D-камеры

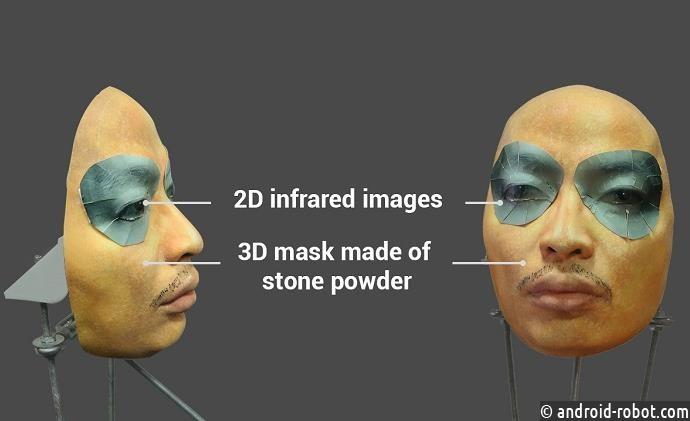

Уязвимость 3D-фотобиометрии продемонстрировали вьетнамские инженеры из компании Bkav, занимающиеся технологиями кибербезопасности. Всего через пару недель после релиза iPhone X они продемонстрировали как можно взломать FaceID с помощью маски, напечатанной на 3D-принтере. Для этого понадобилось предварительно отсканировать лицо владельца смартфона с помощью 3D-сканера. Первая версия маски состояла из четырех компонент: напечатанная на 3D-принтере основа, 2D изображение глаз, силиконовый нос и специально рассчитанные области лица. Вторая версия маски была упрощена до двух компонент: каменная 3D-основы и 2D-изображение глаз.

После публикации этой новости некоторые специалисты по кибербезопасности утверждали, что такой подход не масштабируем, поскольку нужно долго сканировать лицо владельца смартфона. И возможно они действительно были бы правы, если бы к тому моменту не придумали ГАНы.

В 2016 году инженеры из Массачусетского технологического института (MIT) разработали нейронную сеть 3D-GAN, которая позволяет восстанавливать 3D-модели высокого качества по 2D-изображению. Если обучить такую нейросеть на фотографиях лиц, можно создать 3D- маску любого человека, фотографию которого можно достать, например, из социальных сетей.

Уже в 2017 году британские ученые развили эту идею и разработали нейронную сеть VRN, которая создает 3D-маску человека всего по одной фотографии. Разработку выложили в открытый доступ, а демо-версию работы этой нейросети можно протестировать

Возможно, что восстановленные с помощью нейронных сетей 3D-маски пока еще не достаточно точные по сравнению с масками, созданными с помощью 3D-сканеров. Но мы помним, что свёрточные нейронные сети, лежащие в основе фотобиометрии, выделяют очень грубые признаки без глубокой детализации (иначе человек не смог бы пройти фотобиометрию повторно).

После взлома FaceID специалисты из компании Bkav в своем блоге описали другой способ масштабирования взлома 3D-биометрии: 3D-маску можно воссоздавать, снимая фотографию с двух камер, расположенных со сдвигом (стереосъемка). Примерно так и работает большинство 3D-сканеров.

На этом можно закончить с обзором методов взлома систем распознавания лиц.

Экспертное мнение предоставил Сергей Афанасьев, Вице-Президент, Начальник управления статистического анализа банка «Ренессанс Кредит».