Роботы становятся умнее — и быстрее — узнавая, что люди чувствуют и думают, просто «глядя» в их лица, и это может однажды позволить более эмоционально воспринимающим машинам обнаруживать изменения в здоровье или психическом состоянии человека.

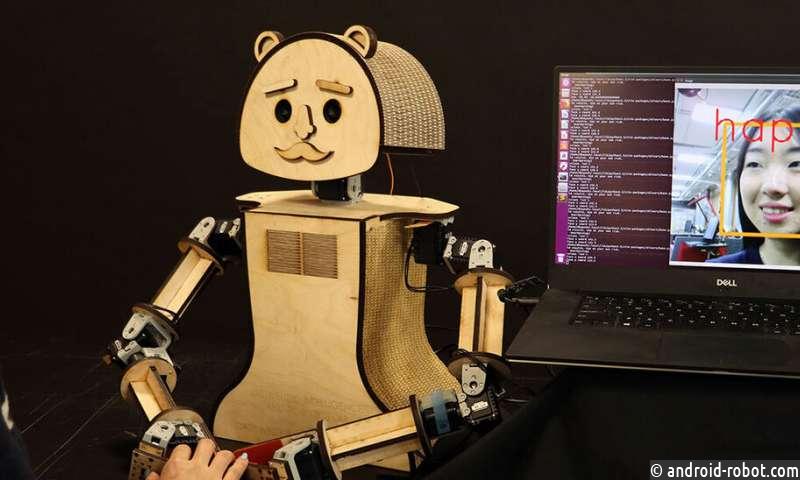

Исследователи из Университета Case Western Reserve утверждают, что они улучшают искусственный интеллект (ИИ), который теперь используется для интерактивных видеоигр, и который вскоре улучшит следующее поколение персонализированных роботов, которые могут сосуществовать вместе с людьми.

И роботы Case Western Reserve делают это в режиме реального времени.

Новые машины , разработанные Kiju Ли, Норд Distinguished доцент в механической и аэрокосмической технике в Case Инженерной школе и аспирант Его Лю, правильно идентифицировать человеческие эмоции от мимики 98 процентов времени, почти мгновенно. Предыдущие результаты других исследователей достигли аналогичных результатов, но роботы часто реагировали слишком медленно.

«Даже трехсекундная пауза может быть неловкой, — сказал Ли. «Людям достаточно сложно — и еще сложнее — роботам — понять, что кто-то чувствует, основываясь исключительно на их выражениях лица или языке тела». Все слои и слои технологии, включая захват видео, к сожалению, также замедляют ответ.»

Ли и Лю ускорили время отклика, объединив два видеофильтра предварительной обработки с другой парой существующих программ, чтобы помочь роботу классифицировать эмоции на основе более чем 3500 вариаций выражения лица человека.

Но это вряд ли наша вариация на лице: люди могут зарегистрировать более 10 000 выражений, и у каждого из них также есть уникальный способ выявить многие из этих эмоций, сказал Ли.

Но компьютеры «глубокого обучения» могут обрабатывать огромные объемы информации, как только эти данные вводятся в программное обеспечение и классифицируются.

И, к счастью, наиболее распространенные выразительные черты среди людей легко разделить на семь эмоций: нейтральные, счастье, гнев, грусть, отвращение, удивление и страх — даже с учетом различий между различными фонами и культурами.

Приложения сейчас и в будущем

По словам Ли, эта недавняя работа Ли и Лю, представленная в 2018 году на IEEE Games, Entertainment и Media Conference, может привести к появлению множества приложений в сочетании с достижениями десятков других исследователей в области ИИ.

Сейчас они также работают над другим подходом, основанным на машинном обучении, для распознавания эмоций лица, который до сих пор достигал точности свыше 99% при еще более высокой вычислительной эффективности.

Когда-нибудь личный робот сможет точно заметить существенные изменения в человеке с помощью ежедневного общения — даже до момента обнаружения ранних признаков депрессии, например.

«Робота можно запрограммировать так, чтобы он рано ловил его и помогал с простыми вмешательствами, такими как музыка и видео, для людей, нуждающихся в социальной терапии», — сказал Ли. «Это может быть очень полезно для пожилых людей, которые могут страдать от депрессии или изменений личности, связанных со старением».

Ли планирует изучить возможность использования социальных роботов для социального и эмоциональноговмешательства у пожилых людей в сотрудничестве с Ohio Living Breckenridge Village. Ожидается, что пожилые жители будут взаимодействовать с дружественным, социально интерактивным роботом и помогать проверять точность и надежность встроенных алгоритмов.

Еще одна возможность в будущем: социальный робот, который изучает более тонкие изменения лица у кого-то в спектре аутизма и который помогает «научить» людей точно распознавать эмоции друг в друге.

«Этим социальным роботам понадобится время, чтобы поймать их в США», — сказал Ли. «Но в таких местах, как Япония, где вокруг роботов существует сильная культура, это уже начинает происходить. В любом случае, наше будущее будет соседствовать с эмоционально умными роботами».