Чиновники хотят, чтобы компьютеры могли принимать решения и объяснять их военным командирам

Передовой исследовательский отдел Министерства обороны обещает крупнейшие инвестиции в системы искусственного интеллекта (ИИ) для американского вооружения. Он обязуется потратить до двух миллиардов долларов в течение следующих пяти лет на новые усилия сделать машинные системы более доверенными для военных руководителей.

Директор Агентства перспективных исследовательских проектов обороны (DARPA) заявил, что видит основную цель в продвижении новых технологий для решения военных проблем, а технические руководители администрации Трампа решительно поддержали внедрение ИИ в оружие Америки как средство лучшего соперничества с российскими и китайскими вооружёнными силами.

DARPA и расходные стандарты

Инвестиции DARPA невелики по сравнению со стандартами расходов Пентагона, где стоимость покупки и обслуживания новых самолетов F-35, как ожидается, превысит триллион долларов.

В июле оборонный подрядчик Буз Аллен Гамильтон получил контракт на 885 миллионов долларов для работы над анонимными программами ИИ в течение пяти лет. И Maven, единственный крупнейший проект военного ИИ, который призван улучшить способность компьютеров выбирать объекты на фотографиях для военного использования, должен получить в 2019 году 93 миллиона долларов.

Обоснование превращения военной аналитической работы – и, возможно, принятия некоторых ключевых решений – в компьютерах и алгоритмах, установленных в оружии и способных порой действовать против людей довольно жестоким образом.

Google руководил проектом Project Maven, но после организованного протеста сотрудников, которые не хотели браться за программное обеспечение, компания заявила, что в июне прекратит работу после истечения срока действующего контракта.

Проблема гуманизма

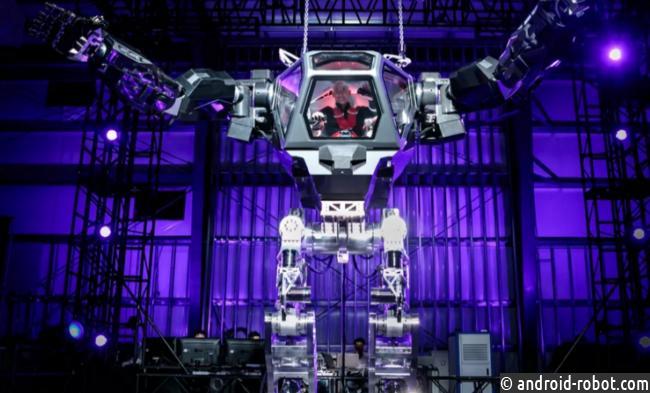

В то время как Maven и другие инициаторы разработки ИИ помогли системам оружия Пентагона стать лучше в распознавании целей и эффективнее в использовании дронов, выведение на борт компьютерных систем, которые самостоятельно могут принимать смертоносные действия, до сих пор не одобрено.

В стратегическом документе Пентагона, опубликованном в августе, говорится о том, что в будущем технологии этой области станут возможными. «Пока в DoD нет автономной системы оружия, которая могла бы искать, идентифицировать, отслеживать и выбирать цель независимо от входа оператора», – говорится в отчёте, который был подписан топ-кандидатами Пентагон и представителями научных исследований Кевином Фахи и Мэри Миллер. «Технологии, лежащие в основе беспилотных систем, позволят разработать и внедрить автономные системы, которые могли бы независимо выбирать и атаковать цели с помощью смертоносной силы», – написано в отчёте.

В докладе отмечалось, что, хоть системы ИИ уже технически способны выбирать цели и управлять оружием, командиры не собираются отказываться от контроля над оружейными платформами частично из-за неуверенности в машинных рассуждениях, особенно на поле битвы, где могут появиться переменные, с которыми разработчики ранее не встречались.

Например, если солдат спрашивает систему ИИ как целевую идентификационную платформу, чтобы выяснить причины её выбора, она может только предоставить оценку доверия своему решения. Оценка часто дается в процентном отношении, как и оценка в вероятности того, что объект, выделенный системой, – это именно тот, кого запрашивал оператор.

«То, что мы пытаемся сделать с ИИ, – это заставить машину сказать человеку: «Вот ответ, и вот почему я думаю, что это правильный ответ», и объяснить человеку, как она получила этот ответ», – сказал директор DAPRA Стивен Уокер.

Должностные лица DARPA не рассказали, как новоиспечённые исследования привели к тому, что компьютеры смогут объяснить ключевые решения для людей на поле битвы в срочности конфликта, но заявили, что возможность сделать это весьма вероятна для будущего ИИ в армии.

Человеческое решение и рациональность важнее

Препятствия в объяснении логики ИИ операторам

в реальном времени может стать серьёзной проблемой. Процесс принятия решений и рациональность человека зависят не только от правил, в которых хороши машины. Человек много лет развивает моральные способности и здравый смысл, – характеристики, которые ещё пытаются создать в цифровых машинах, но это маловероятно.

– Нам нужен какой-то гигантский проект, чтобы создать систему ИИ, которая будет обладать компетенцией трёхлетнего возраста, — сказал Рон Брачман, который три года руководил программами AI DARPA. – В прошлом у нас были экспертные системы и надёжные роботизированные системы. Мы знаем, как распознавать изображения в гигантских базах данных фотографий, но вся совокупность, в том числе того, что люди время от времени называют здравым смыслом, до сих пор неуловим в этой области.

Майкл Хоровиц, который работал над вопросами ИИ для Пентагона в качестве помощника в канцелярии министра обороны в 2013 году и в сейчас является профессором Пенсильванского университета, объяснил в интервью, что «существует большая озабоченность по поводу безопасности ИИ – в алгоритмах, которые неспособны адаптироваться к сложной реальности и, таким образом, работают непредсказуемо. Одно дело, если вы говорите о поиске Google, но другое, если вы говорите о системе вооружения».

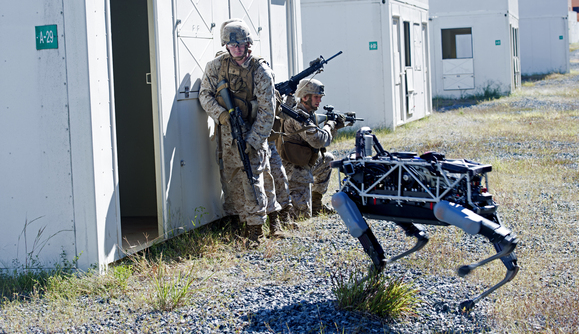

Расширение использования ИИ военными было одобрено Советом по оборонным наукам в 2016 году. Подчеркнули, что в военных конфликтах машины действуют быстрее, чем люди. Но с этими быстрыми решениями, добавил он, возникают сомнения у тех, кому приходится на поле битвы полагаться на технику.

«Командиры понимают, что они могут извлечь выгоду из более качественной и организованной, более актуальной и точной информации, обеспечиваемой применением автономии в боевых действиях, но в то же время они серьёзно озабочены», – говорится в докладе.

Горовиц добавил, что, вероятно, руководители захотят использовать системы ИИ, если те смогут доказать, что руководствуются здравым смыслом.

DARPA – это не единственное подразделение Пентагона, спонсирующее исследование ИИ. Администрация Трампа сейчас находится в процессе создания нового Объединённого центра ИИ, чтобы скоординировать все программы, связанные с ИИ, в оборонном отделе. Но запланированные инвестиции DARPA пока ограничиваются собственными возможностями.

Серьёзные планы на будущее

По данным агентства, в DARPA сейчас имеется около 25 программ, ориентированных на исследования ИИ, но планируется внедрить новую программу исследований. Эта программа, объявленная в июле, получит грант в размере до миллиона долларов США для исследования понимая контекста системами ИИ, что позволит им эффективнее работать в сложных условиях.

Уокер сказал, что, позволяя системам ИИ принимать решения, даже в сложной ситуации не только на поле боя, но и среди руководителей, и затем объяснять эти решения своим операторам, будет «критически важным в сценарии боевых действий».